查看

共享AR场景视频呼叫系统

(

在名为“Generatingsharedaugmentedrealityscenesutilizingvideotexturesfromvideostreamsofvideocallparticipants”的专利申请中,Meta就介绍了一种利用视频呼叫参与者视频流中的视频纹理来生成共享增强现实场景的方法。

在一个实施例中,专利描述的系统建立视频呼叫流,以启用在视频呼叫期间将视频呼叫的参与者描述为AR效果的视频纹理所施加的共享AR场景。例如,共享AR场景视频呼叫系统为客户端设备之间的视频呼叫建立视频呼叫流通道。

实际上,共享AR场景视频呼叫系统使正在进行视频呼叫的客户端设备能够通过视频呼叫流通道传输视频数据和视频处理数据,以促进客户端设备为视频呼叫中的AR场景中的视频呼叫参与者呈现视频纹理。

举例说明,共享AR场景视频呼叫系统使得客户端设备能够利用视频数据和相应的视频处理数据,在客户端设备视频呼叫界面显示的AR场景AR效果中将参与者的视频渲染为视频纹理。

另外,在视频通话期间启动AR场景时,共享AR场景视频通话系统使得参与视频通话的客户端设备能够在描绘3D(或2D)图形场景的视频通话界面中呈现AR场景,而不是仅在客户端设备之间呈现捕获的视频。

同时,共享AR场景视频呼叫系统使得客户端设备能够接收来自其他参与者客户端设备的视频处理数据,并利用视频处理数据将参与者的视频渲染为AR场景中AR效果中的视频纹理。事实上,共享AR场景视频呼叫系统可以使客户端设备将视频呼叫作为AR场景呈现,其中视频呼叫的参与者作为视频纹理描绘为在AR场景中,而不是简单地在客户端设备之间呈现捕获的视频。

在接收到视频处理数据后,共享AR场景视频呼叫系统可以允许客户端设备利用参与者客户端设备的视频数据和视频处理数据,从而将单个参与者的视频渲染为AR效果中的视频纹理。

在一个或多个实施例中,共享AR场景视频呼叫系统使客户端设备能够为每个参与者呈现视频纹理,使得在同一客户端设备上捕获的多个参与者在视频呼叫的AR场景中呈现为单独的视频纹理。

如上所述,与传统视频呼叫系统相比,共享AR场景视频通话系统具有一系列的优势。例如,共享AR场景视频呼叫系统可以在多个参与者设备之间建立并实现动态和灵活的视频呼叫,并将参与者作为AR效果包含在共享AR场景环境中。简单来说,共享AR场景视频呼叫系统允许参与者启动AR场景,并呈现描绘视频呼叫参与者的视频纹理。

除了通过将参与者呈现为AR场景中的视频纹理来改进传统视频通话的功能外,共享AR场景视频通话系统同时能够准确地将在其他客户端设备捕获的参与者呈现为AR场景中的视频纹理,而无需访问原始视频数据和来自客户端设备的原始视频处理数据追踪。

特别是,通过建立专用的视频处理数据通道,在视频通话期间跨客户端设备传输视频流的视频处理数据,共享AR场景视频通话系统使得客户端设备能够从其他客户端设备捕获的视频中准确识别参与者感兴趣区域,例如面部、头发和眼睛。反过来,共享AR场景视频呼叫系统使得客户端设备能够渲染视频纹理,准确地将感兴趣区域与AR效果结合起来。

实际上,共享AR场景视频呼叫系统使得参与视频呼叫的客户端设备能够在视频呼叫建立多个参与者的视频追踪,而无需每个客户端设备为每个参与者处理相关信息的原始视频。因此,共享AR场景视频呼叫系统能够有效地利用计算资源。

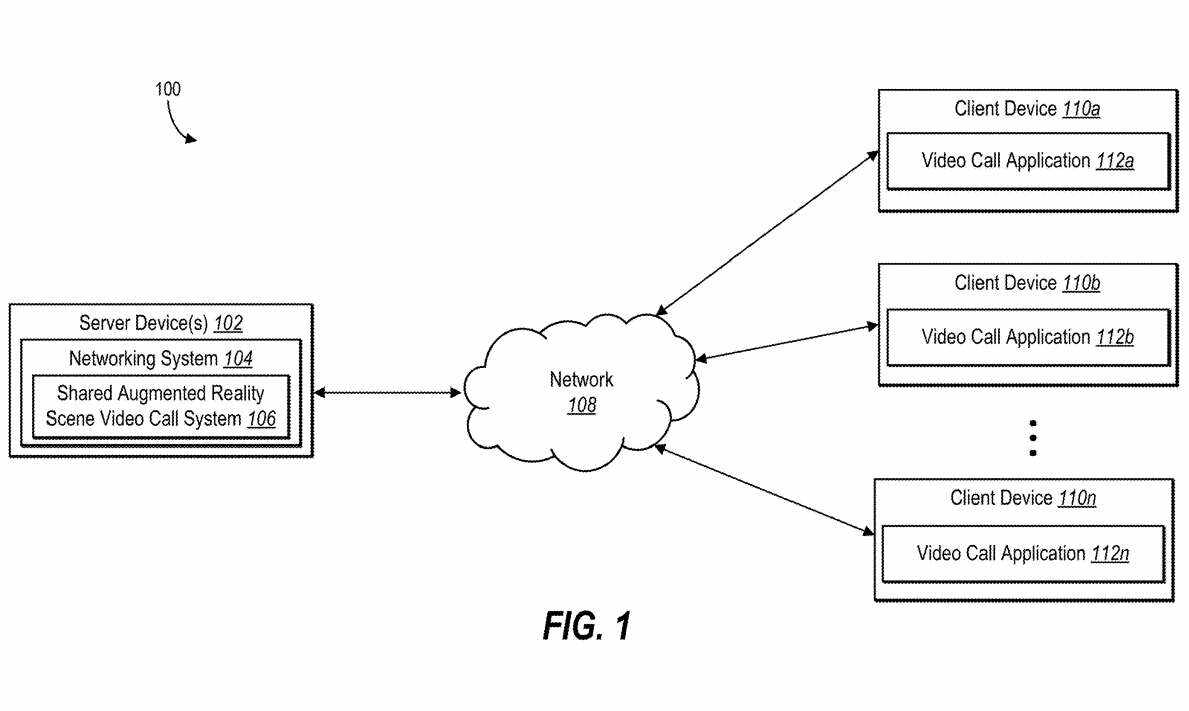

图1示出了实现共享增强现实场景视频呼叫系统106的环境100。如图1所示,环境100包括服务器设备102、网络108和客户端设备110a-110n。

服务器设备102、网络108和客户端设备110a-110n可以直接或间接地彼此通信耦合。环境100包括服务器设备102,而服务器设备102生成、存储、接收和/或传输数字数据,包括与客户端设备之间的视频呼叫的视频数据和视频处理数据相关的数字数据。

服务器设备102包括网络系统104。特别是,网络系统104可以提供数字平台。网络系统104可以提供消息传递功能、聊天功能和/或视频呼叫功能,通过所述功能,用户可以与一个或多个共同用户进行通信。

在其他实施例中,网络系统104可以包括另一种类型的系统,包括电子邮件系统、视频通话系统、搜索引擎系统、电子商务系统和银行系统等等。

如图1所示,服务器设备102包括共享AR场景视频呼叫系统106。在一个或多个实施例中,共享AR场景视频呼叫系统106在客户端设备之间建立视频呼叫流通道,以实现客户端设备之间的视频呼叫,并使客户端设备能够将参与者的视频呈现为共享AR场景中AR效果内的视频纹理。

实际上,共享AR场景视频呼叫系统106建立视频呼叫,从而允许客户端设备呈现视频呼叫界面,并显示具有视频呼叫参与者作为AR场景中的AR元素的AR场景。

如上所述,共享AR场景视频通话系统106可以允许客户端设备在视频通话期间将带有描绘视频通话参与者的视频纹理的共享AR场景渲染为AR效果。

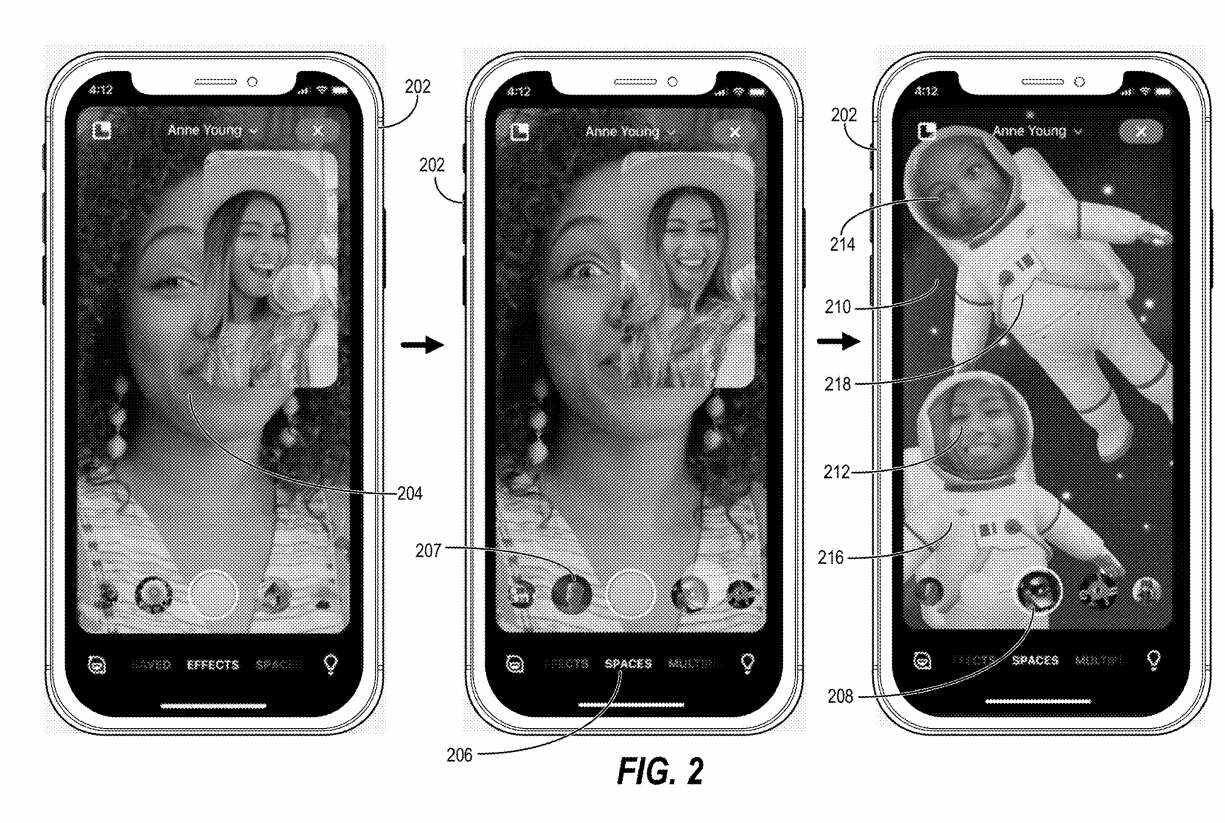

图2示出了共享AR场景视频呼叫系统106。所述系统使得参与视频呼叫的客户端设备能够与视频呼叫的参与者作为共享AR场景内的AR效果发起共享AR场景视频呼叫。例如,共享AR场景视频呼叫系统106使客户端设备202能够显示用于参与者之间视频呼叫的视频呼叫界面204。

另外,客户端设备202显示可选选项206,以在视频通话期间启动共享AR场景。在检测到可选选项206的选择后,客户端设备202显示可选AR场景选项207。

客户端设备202从可选AR场景选项207接收特定AR场景选项208的选择。随后,客户端设备202利用视频数据和视频处理数据将参与者的视频渲染为AR效果216、218内的AR场景环境210中的视频纹理212、214。

如上所述,共享AR场景视频通话系统106可以使参与视频通话的客户端设备传输视频数据和视频处理数据,从而在视频通话过程中呈现共享AR场景,其中参与者的视频可以作为AR效果中的视频纹理。

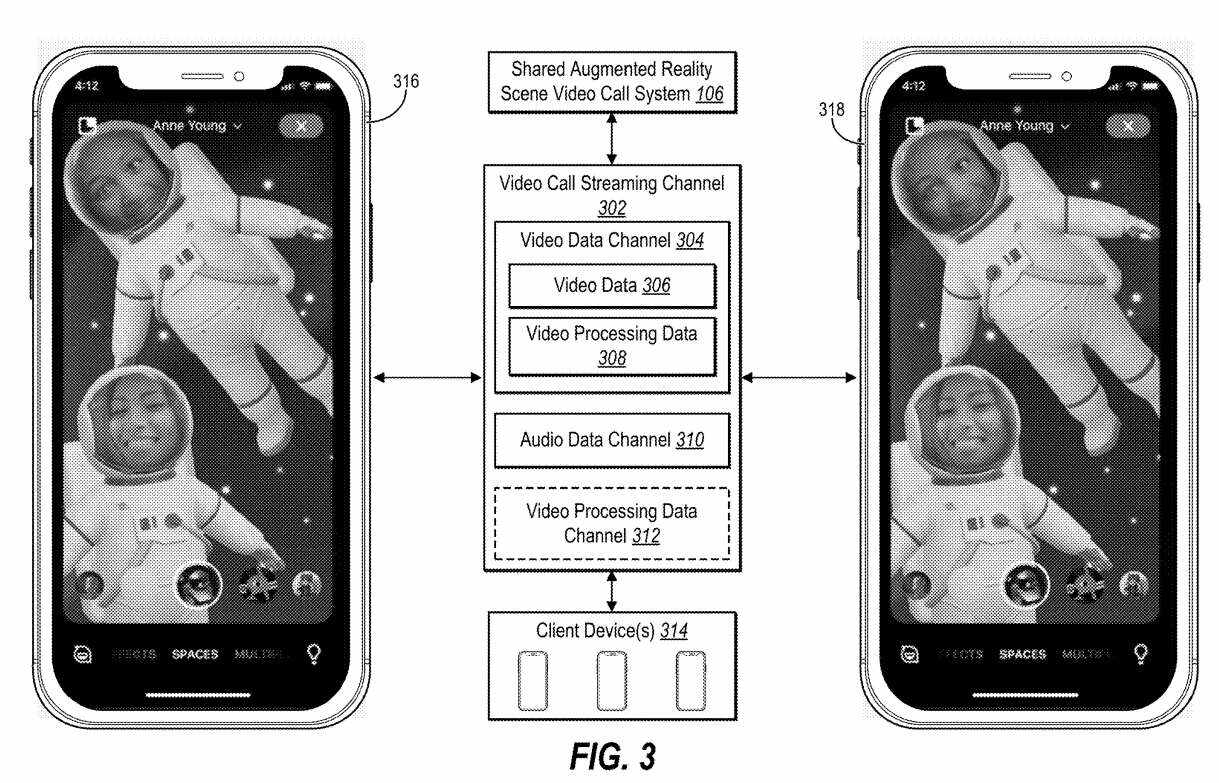

图3示出了共享AR场景视频呼叫系统106。共享AR场景视频呼叫系统106建立了视频呼叫流通道,使客户端设备能够在视频呼叫期间传输视频数据和视频处理数据。

实际上,图3示出了共享AR场景视频呼叫系统106,而共享AR场景视频呼叫系统106使得客户端设备能够通过视频呼叫流通道传输视频数据和视频处理数据,以使客户端设备能够在视频呼叫期间将带有描述视频呼叫参与者的视频纹理的共享AR场景呈现为AR效果。

如图3所示,共享AR场景视频呼叫系统106建立视频呼叫流通道302,其中流通道包括视频数据通道304和音频数据通道310。共享AR场景视频呼叫系统106在客户端设备316和客户端设备318之间建立视频呼叫流。

具体而言,共享AR场景视频呼叫系统106建立具有视频数据通道304的视频呼叫流通道302,以实现客户端设备316与客户端设备318之间的视频通信。客户端设备316、318可以通过视频数据通道304传输视频数据306和视频处理数据308。

在一个实施例中,客户端设备316和客户端设备318还通过音频数据通道310传输来自在各自客户端设备上捕获的音频的音频数据。视频呼叫流通道302同时可以包括视频处理数据通道312。

参照图3,所述客户端设备316和所述客户端设备318分别使用所述客户端设备捕获参与者的视频。另外,客户端设备316、318还可以对所捕获的视频识别视频处理数据。然后,在客户端设备316、318利用分割视频帧通过视频呼叫流通道302。

客户端设备316、318接收视频数据306和视频处理数据308的组合,并利用所述数据在视频通话期间呈现共享AR场景。如图3所示,客户端设备316,318利用描绘视频呼叫参与者的视频数据来呈现AR效果中的视频纹理。然后,客户端设备316,318在视频通话界面内提供基于视频纹理的AR效果的显示。

在一个实施例中,共享AR场景视频呼叫系统106建立视频处理数据通道,以利用一种或多种数据交换格式来促进视频处理数据在视频处理数据通道内的传输。

在一个实施例中,共享AR场景视频呼叫系统106可以利用视频或图像通信通道作为视频处理数据通道。例如,共享AR场景视频呼叫系统106可以建立便于传输视频、视频帧和/或图像的数据通道作为视频处理数据通道。

在一个实施例中,共享AR场景视频呼叫系统106可以使客户端设备能够从捕获的视频中呈现视频纹理并通过视频处理数据通道传输视频纹理。例如在视频通话期间,客户端设备可以通过视频处理数据通道从参与者客户端设备接收视频纹理,并在AR效果中利用视频纹理。

在一个实施例中,共享AR场景视频呼叫系统106可以使客户端设备能够利用机器学习模在视频呼叫期间通过视频处理数据通道接收和处理来自参与者客户端设备的视频纹理。

在一个实施例中,共享AR场景视频呼叫系统106可以在多个客户端设备之间启用共享AR场景视频呼叫。例如,共享AR场景视频呼叫系统106可以在客户端设备316、客户端设备318和一个或多个客户端设备314之间建立视频呼叫流通道302。

实际上,在通过视频呼叫流通道302传输视频处理数据时,客户端设备316、客户端设备318和客户端设备314中的一个或多个可以将参与者的视频呈现为在多个客户端设备的视频呼叫界面内显示的视频纹理。

如上所述,共享AR场景视频通话系统106可以使客户端设备在视频通话期间将参与者的视频渲染为AR场景中AR效果中的视频纹理。

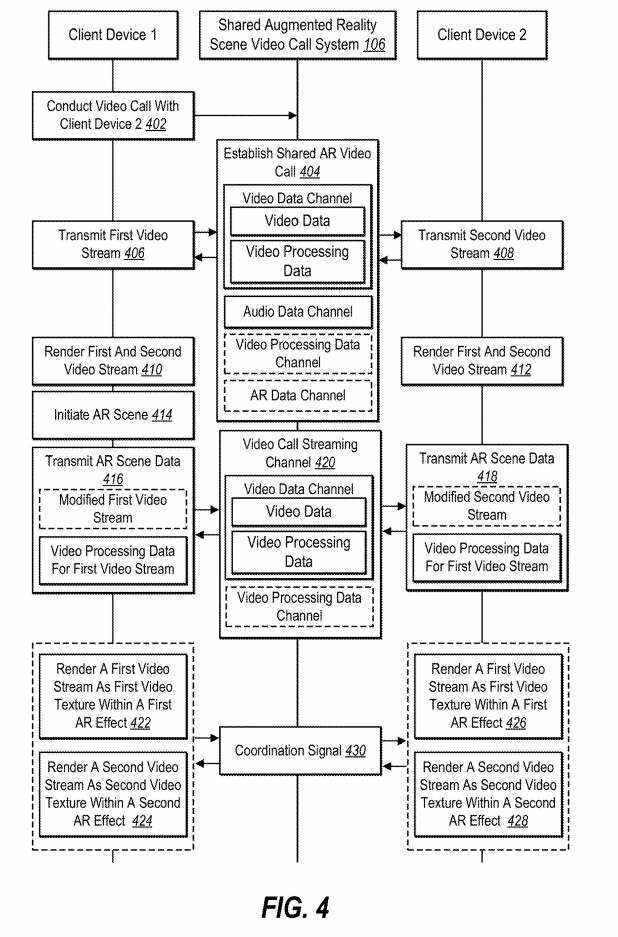

图4示出了共享AR场景视频呼叫系统106在客户端设备之间建立共享AR场景视频呼叫的流程图。如图4所示,共享AR场景视频呼叫系统106可以使客户端设备在视频呼叫过程中传输视频数据和视频处理数据,从而将参与者的视频呈现为AR场景中AR效果内的视频纹理。

在402,共享AR场景视频呼叫系统106接收来自客户端设备1的与客户端设备2进行视频呼叫的请求。

在404,共享AR场景视频呼叫系统106在客户端设备1和客户端设备2之间建立共享AR场景视频呼叫。

在406,客户端设备1通过视频数据通道和音频数据通道向客户端设备2发送第一视频流。在408,客户端设备2通过视频数据通道和音频数据通道向客户端设备1发送第二视频流。

在410,客户端设备1呈现第一和第二视频流。在412,客户端设备2同样呈现第一和第二视频流。

在414,客户端设备1在与客户端设备2进行视频通话期间发起共享AR场景。在416,客户端设备1通过视频呼叫流向客户端设备2传输AR场景数据。在418,客户端设备2同时通过视频呼叫流向客户端设备1传输AR场景数据。

在422,客户端设备1利用第一视频流和用于第一视频流的视频处理数据将第一视频流渲染为AR场景中第一AR效果内的第一视频纹理。另外在424,客户端设备1利用从客户端设备2接收到的视频数据和视频处理数据,将第二视频流渲染为第二AR效果中的第二视频纹理。

通过这样做,客户端1可以将视频呼叫呈现为AR场景,其中视频呼叫的参与者可以作为视频纹理描绘为AR场景内,而不是简单地在客户端设备之间呈现捕获的视频。

在426所示,客户端设备2利用从客户端设备1接收的视频数据和视频处理数据,将第一视频流渲染为第一AR效果中的第一视频纹理。在428,客户端设备2进一步利用第二视频流和用于第二视频流的视频处理数据,将第二视频流渲染为AR场景中第一AR效果内的第二视频纹理。

因此,客户端2同样可以将视频呼叫呈现为AR场景,其中视频呼叫的参与者作为视频纹理描绘为在AR场景中。

如上所述,共享AR场景视频呼叫系统106可以使客户端设备在视频呼叫期间利用各种类型的视频处理数据来呈现AR场景内参与者的视频纹理。

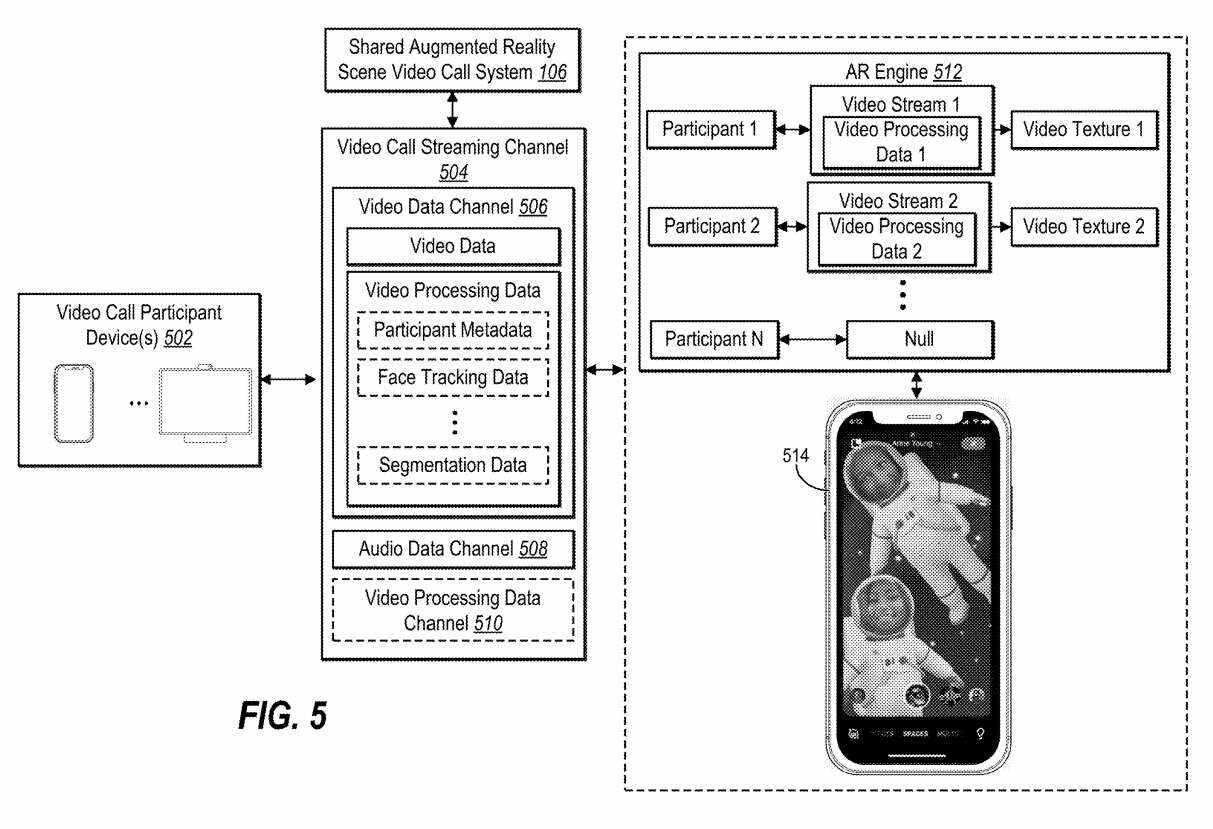

图5示出了接收并利用来自另一参与者设备的视频处理数据来呈现AR场景中参与者的视频纹理的客户端设备。具体地,图5示出了利用AR引擎的客户端设备。其中,所述引擎利用视频数据和视频处理数据在视频通话期间在自视图显示中呈现AR场景内参与者的视频纹理。

共享AR场景视频呼叫系统106在视频呼叫期间利用视频呼叫流通道504在视频呼叫参与者设备502和客户端设备514之间建立通信。

如图5所示,视频呼叫参与设备502通过视频呼叫流通道504传输视频数据和视频处理数据。更具体地说,视频呼叫参与者设备502将视频数据和视频处理数据作为组合数据传输。

视频处理数据可以包括参与者元数据。共享AR场景视频呼叫系统106使客户端设备能够利用参与者元数据来识别参与者,以便在AR场景中包括作为视频纹理的参与者,确定要为AR场景中的参与者使用的AR效果类型,和/或呈现与参与者对应的其他信息。例如,与会者元数据可以包括与会者标识、与会者状态和/或视频通话信息。

在一个实施例中,参与者元数据包括AR标识符,所述标识符指示要为参与者使用的AR效果类型或特定AR效果。在一个实施例,视频处理数据可以包括人脸追踪数据。例如,共享AR场景视频呼叫系统106可以使客户端设备能够识别、追踪和指示来自捕获视频的面部追踪信息。

MetaPatent|Generatingsharedaugmentedrealityscenesutilizingvideotexturesfromvideostreamsofvideocallparticipants

名为“Generatingsharedaugmentedrealityscenesutilizingvideotexturesfromvideostreamsofvideocallparticipants”的Meta专利申请最初在2022年5月提交,并在日前由美国专利商标局公布。